TU Darmstadt

15.07.2020, 10:00 Uhr

Spionage-Abwehr gegen mithörende Smart-Home-Geräte

Ein Forschungsteam an der TU Darmstadt hat mit Partnern aus den USA und Frankreich ein Gerät entwickelt, das Smart-Home-Geräte mit Sprachassistenz erkennen kann, die ohne Zustimmung der Nutzenden aufgezeichnete Audioaufnahmen ins Internet streamen.

Das Forschungsteam der TU Darmstadt konnte nachweisen, dass viele Smart-Home-Geräte mit integrierter Sprachassistenz unabsichtlich Gespräche mithören können. Typischerweise werden Sprachassistenten mit einem Weckwort aktiviert. Das Team hat extensiv Experimente mit Sprachassistenten wie Alexa durchgeführt und zahlreiche englische Wörter identifiziert, die Alexa fälschlicherweise als Weckwort interpretiert. Dadurch wird der Sprachassistent aktiviert, was zu einer unerwarteten Audioübertragung führt. Die ungewollt von Alexa aufgezeichneten Audio-Daten werden dann in die Cloud hochgeladen und von Amazon analysiert. Um dem entgegenzuwirken, haben die Forscherinnen und Forscher ein Gerät als Gegenmaßname entwickelt und einen funktionstüchtigen Prototypen gebaut.

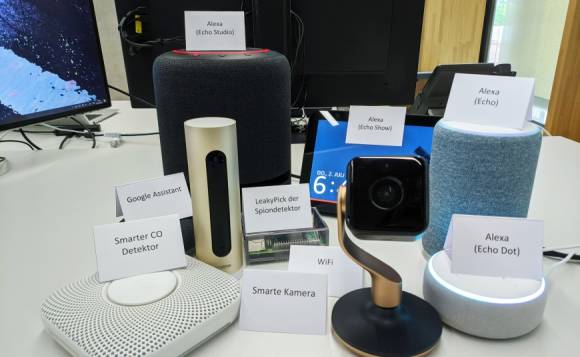

Das Gerät mit dem Namen LeakyPick kann im Smart Home eines Benutzers platziert werden und in regelmäßigen Abständen die anderen Sprachassistenten in seiner Umgebung mit Audio-Befehlen testen. Der nachfolgende Netzwerkverkehr wird auf statistische Muster hin überwacht, die auf eine Audioübertragung hinweisen. LeakyPick weist dann auf die Geräte hin, die die ungewollte Audioaufzeichnung durchführen.

Das LeakyPick-Gerät könnte auch gegen einen raffinierten Angriff auf den Sprachassistenten Alexa helfen: Dabei werden Weckwörter und Befehle von Angreifern in dem für die Menschen unhörbaren Ultraschall-Bereich gesendet und so zum Beispiel Bestellungen beim Online-Versandhändler Amazon getätigt. Die Ultraschall-Befehle sind nicht hörbar für das menschliche Ohr, werden aber von Alexa verstanden. Wenn das LeakyPick-Gerät also eine Aktivität feststellt, obwohl kein hörbarer Befehl erfolgt ist, könnte das auf einen solchen Angriff hindeuten.